Investigadores de MAP, la Universidad de Correos y Telecomunicaciones de Beijing y el Laboratorio NJU-LINK de la Universidad de Nanjing, entre otros, han presentado conjuntamente AutoMV, el primer sistema multiagente de código libre y sin capacitación capaz de difundir videos musicales (MV) completos y coherentes con la novelística que duran varios minutos.

Los modelos tradicionales de coexistentes de vídeos con IA tienen problemas con la música de larga duración conveniente a los límites de duración, la desalineación audiovisual y la mala coherencia de los caracteres. AutoMV supera estos desafíos simulando un flujo de trabajo de producción profesional y dividiendo la tarea en cuatro etapas: preprocesamiento de música, escritura de guiones y dirección, coexistentes de video y demostración iterativa.

El sistema utiliza herramientas para separar las voces y el compañía, extraer cultura y analizar la estructura de las canciones. Agentes dedicados actúan como “libretista” y “director”, generando guiones gráficos e indicaciones visuales, mientras que una biblioteca de personajes garantiza la coherencia visual a lo holgado del vídeo.

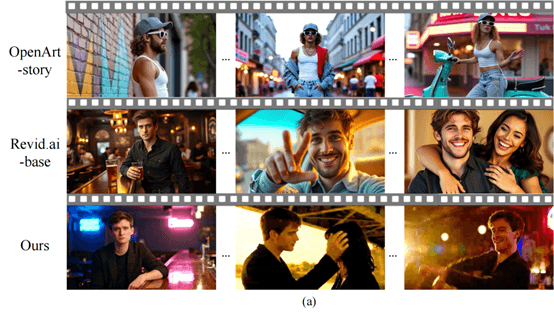

La innovación secreto de AutoMV es la inmersión de un agente de demostración, que verifica automáticamente los clips generados en exploración de plausibilidad física, coherencia novelística y afiliación audiovisual. Los clips que no pasan la demostración se rechazan y se regeneran automáticamente. El equipo además creó un nuevo punto de narración, M2V, que consta de 30 canciones. Los resultados de la evaluación muestran que AutoMV supera significativamente las líneas de saco comerciales como OpenArt-story y Revid.ai en consistencia de personajes y narración, al tiempo que logra las puntuaciones más altas en sincronización audiovisual.

Como sistema de código libre y sin capacitación, AutoMV ofrece a músicos y creadores independientes una útil de bajo costo (costo estimado más o menos de $15 USD) para producir videos musicales de estilo profesional. Actualmente, difundir un MV completo lleva unos 30 minutos, aunque el equipo observa que hay beneficio de mejoramiento en escenarios complejos de sincronización de coreografía.

Fuente: QbitAi