Ámbito de mandato de riesgos de IA. Publicado el 26 de enero de 2023, RMF de IA del NIST fue desarrollado para ejecutar mejor los riesgos para los individuos, las organizaciones y la sociedad asociados con la IA. “Lo que estamos tratando de hacer con el Ámbito de Trámite de Riesgos de IA es comprender cómo confiamos en la IA, que opera de muchas maneras diferentes en algunas de estas tareas que conocemos muy acertadamente”, particularmente en lo que respecta a cómo las aplicaciones de detención impacto afectan la ciberseguridad. Martín Stanleydijo en el taller el investigador principal de IA y ciberseguridad del NIST.

Centro de Innovación y Estándares de IA (CAISI). CAISI del NIST sirve como “el principal punto de contacto de la industria en el interior del gobierno de EE. UU. para simplificar las pruebas y la investigación colaborativa relacionadas con el utilización y la protección del potencial de los sistemas comerciales de IA”, dijo Maia Hamínmiembro del personal técnico de CAISI, el centro que desarrolla mejores prácticas y estándares para mejorar la seguridad y la colaboración de la IA. Además “lidera evaluaciones y valoraciones de los sistemas de inteligencia fabricado de Estados Unidos y sus adversarios, incluida la admisión de modelos extranjeros, posibles vulnerabilidades de seguridad o potencial de influencia extranjera”, dijo a los asistentes al taller.

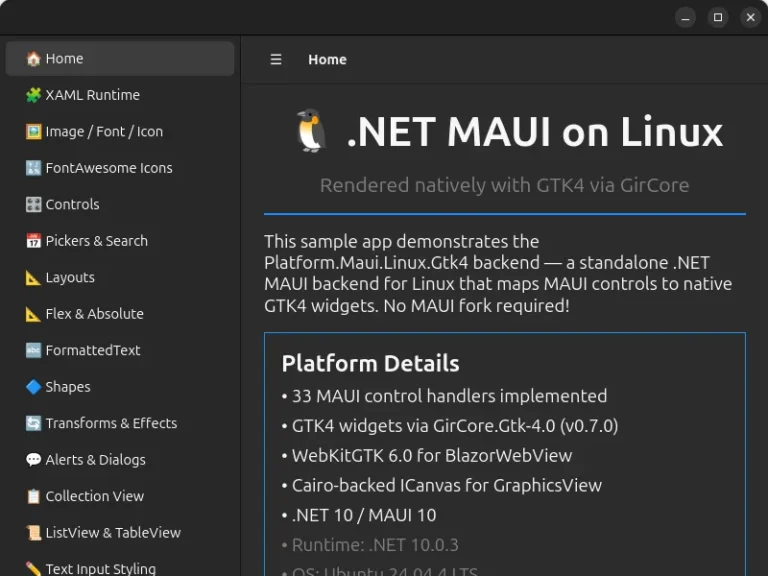

NIST AI 100-2 E2025, Educación obligatorio adversario: una taxonomía y terminología de ataques y mitigaciones. Este informe del NISTpublicado en marzo de 2025, proporciona una taxonomía de conceptos y define la terminología en el campo del formación obligatorio adversario (AML). “El formación obligatorio adversario o la IA adversaria es el campo que estudia los ataques a sistemas de IA que explotan la naturaleza estadística y basada en datos de esta tecnología”, supervisor del equipo de investigación del NIST. Apóstol Vasilev dijo en el taller. “El secuestro, la inyección rápida, la inyección rápida indirecta, el envenenamiento de datos, todas estas cosas son parte del campo de estudio de la IA adversaria”, aclaró.