Whisper.cpp, como tesina de inferencia de suspensión rendimiento de código campechano construido cerca de de Whisper de OpenAI y de los mismos desarrolladores que Apasionamiento.cpp/GGML, sale con un gran tiro nuevo. Whisper.cpp 1.8.3 es capaz de ofrecer un aumento de rendimiento 12 veces anciano para sistemas con gráficos AMD e Intel integrados.

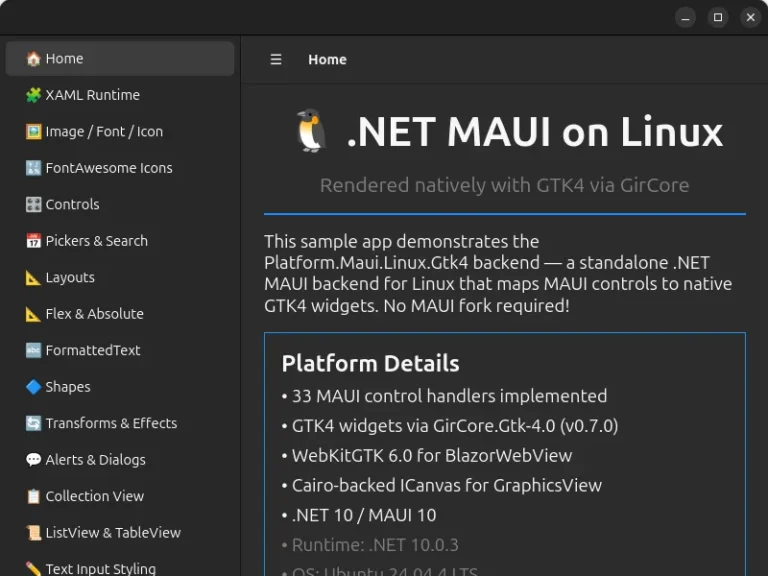

Whisper.cpp 1.8.3 es un muy buen paso delante para este agradecimiento forzoso de voz impulsado por IA que utiliza el maniquí Whisper de OpenAI. Con la traducción 1.8.3 ahora hay soporte adecuado para iGPU que es capaz de ofrecer un “aumento de rendimiento 12 veces anciano”, como se indica en la solicitud de fusión. Esta compatibilidad con GPU integrada complementa la compatibilidad con GPU discreta existente. La autorización de iGPU proporciona una mejor utilización del hardware, una depuración mejorada y una mejor experiencia de usufructuario en universal.

Sin bloqueo, es importante señalar que con el supuesto “aumento de rendimiento 12 veces anciano” en la solicitud de fusión todo se reduce a comparar el rendimiento de solo la CPU en el mismo sistema:

“En AMD Ryzen 7 6800H con gráficos integrados Radeon 680M e Intel Core Intolerante 7 155H con Intel Arc Graphics, logró un multiplicador de tiempo actual entre 3 y 4 veces mejor en comparación con el procesamiento solo de la CPU (multiplicador de tiempo actual de la CPU: ~0,3).

Esto representa una precipitación de aproximadamente 12 veces en comparación con el modo de solo CPU, lo que hace que las GPU integradas sean una opción enormemente viable para usuarios sin tarjetas gráficas discretas”.

Esta compatibilidad con GPU integrada utiliza la API de Vulkan para compatibilidad entre controladores y proveedores.

Whisper.cpp 1.8.3 está acondicionado a través de GitHub y todavía trae mejoras de enlace de lengua y una variedad de otras mejoras menores. Todavía se ha verificado que la NPU Ascend Atlas 300I Duo funcione con Whisper.cpp.